Por Luis Carmona.

En las últimas semanas, Grok, la inteligencia artificial integrada en la red social X (antes Twitter), se ha visto envuelta en una fuerte controversia luego de que usuarios descubrieran que la herramienta es capaz de editar imágenes de personas reales sin su consentimiento, incluso cuando dichas modificaciones implican cambios sensibles en la apariencia de la imagen original.

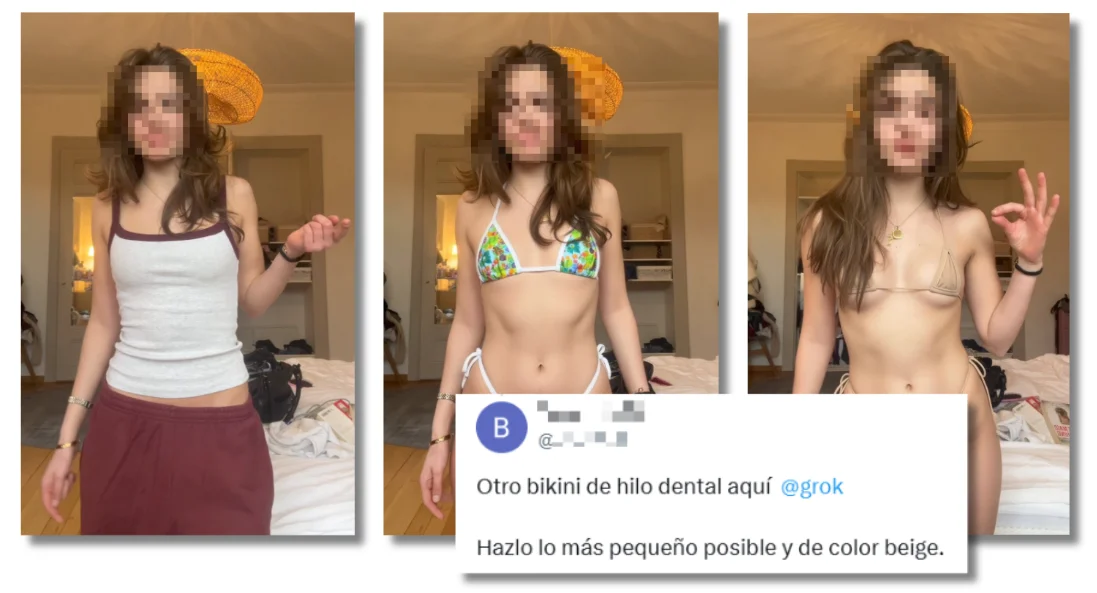

El patrón suele repetirse: un usuario toma una fotografía pública (generalmente de mujeres) publicada en la plataforma y responde directamente a ella etiquetando a @grok, acompañado de instrucciones como “ponle un vestido distinto”, “cámbiale la ropa por un bikini” o “hazla ver más sexy”. En muchos de estos casos, la IA responde generando y publicando una imagen editada de manera automática, sin verificar si la persona retratada autorizó el uso de su imagen ni el tipo de modificación solicitada. Estas interacciones, visibles para otros usuarios, facilitan la viralización del contenido y han encendido alarmas sobre el uso irresponsable de la inteligencia artificial y la falta de controles efectivos dentro de la plataforma.

El fenómeno ha generado indignación, principalmente porque estas ediciones se realizan a partir de fotografías públicas de mujeres, tomadas directamente de sus perfiles, sin autorización alguna. Al etiquetar a Grok con instrucciones específicas, la IA responde generando imágenes alteradas que, por su nivel de realismo, pueden confundirse fácilmente con fotografías auténticas.

Ediciones hiperrealistas y deepfakes no consensuados

Lo que más preocupa a especialistas y usuarios es que las imágenes generadas por Grok no parecen montajes evidentes, sino fotografías reales, lo que las convierte en una forma de deepfake no consensuado. Esta práctica no solo vulnera la privacidad de las personas afectadas, sino que también abre la puerta a daños reputacionales, acoso digital y violencia simbólica, especialmente hacia mujeres.

Aunque algunas ediciones pueden parecer “inofensivas” a simple vista, el problema central radica en que la persona retratada no tiene control ni conocimiento sobre el uso de su imagen, ni sobre la forma en que esta es reinterpretada o difundida.

¿Es legal lo que está ocurriendo?

Desde el punto de vista legal, la situación se mueve en un terreno delicado. En muchos países, la creación y difusión de imágenes alteradas con fines sexuales sin consentimiento puede constituir un delito, especialmente si se considera una forma de violencia digital o una violación al derecho a la propia imagen.

El riesgo se agrava en los casos en los que las imágenes editadas involucran menores de edad, lo que podría derivar en delitos graves relacionados con material de abuso sexual infantil, independientemente de que la imagen haya sido generada por inteligencia artificial.

Responsabilidad: usuarios y plataforma

La polémica ha reavivado el debate sobre quién debe responder legalmente en este tipo de situaciones:

- Los usuarios que solicitan y difunden estas ediciones podrían enfrentar consecuencias legales similares a las de quienes comparten contenido íntimo sin consentimiento.

- La plataforma X y xAI, como desarrolladores y facilitadores de la herramienta, están bajo escrutinio por la falta de filtros eficaces que impidan estos usos indebidos.

- Diversos gobiernos y organismos reguladores han comenzado a exigir explicaciones y acciones concretas a la empresa, señalando posibles incumplimientos de leyes de seguridad digital y protección de datos.

La postura de Elon Musk

Elon Musk, propietario de X y figura clave detrás de xAI, ha declarado que los usuarios que utilicen Grok para generar contenido ilegal enfrentarán las mismas consecuencias que si publicaran dicho contenido por cuenta propia. Sin embargo, sus declaraciones han sido consideradas por algunos sectores como insuficientes o ambiguas, ya que no se han detallado sanciones claras ni plazos específicos para corregir estas fallas.

Aunque Musk ha reconocido que existen errores en los sistemas de seguridad de Grok, críticos señalan que la reacción inicial fue tardía y que la moderación sigue siendo deficiente.

¿Habrá consecuencias y cambios?

X ha asegurado que eliminará contenido ilegal y que mejorará los filtros de seguridad de Grok, pero hasta ahora no existe certeza sobre la eficacia real de estas medidas. La presión internacional apunta a que, de no corregirse el problema, podrían imponerse sanciones regulatorias más severas.

Mientras tanto, usuarios continúan aprovechando la capacidad de la IA, lo que evidencia una brecha preocupante entre el avance tecnológico y la regulación existente.

¿Qué pueden hacer las personas afectadas?

Las personas cuya imagen ha sido alterada sin consentimiento pueden:

- Reportar el contenido directamente en la plataforma.

- Conservar evidencia (capturas de pantalla y enlaces).

- Buscar asesoría legal especializada en delitos digitales.

- Solicitar la eliminación del contenido con base en leyes de privacidad y derechos de imagen.

Un precedente para el futuro de la IA

El caso de Grok marca un punto de inflexión en el debate sobre la inteligencia artificial y el consentimiento digital. A medida que estas tecnologías se vuelven más realistas y accesibles, crece la urgencia de establecer límites claros, tanto técnicos como legales, que protejan a las personas de abusos.

La pregunta ya no es si la IA puede hacerlo, sino si debería hacerlo y bajo qué condiciones. De no abordarse a tiempo, esta problemática podría normalizar prácticas que vulneren derechos fundamentales en nombre de la innovación.